選択した場所の風景やアップロードした画像にAIがピッタリくる音をその場で探してくれるウェブサービス『Imaginary Soundscape』の最新版が公開

モデルとサウンドライブラリーを拡張した高精度エンジンをライセンス販売

・Imaginary Soundscape ウェブサイト:https://www.imaginarysoundscape.net/

- Imaginary Soundscapeとは

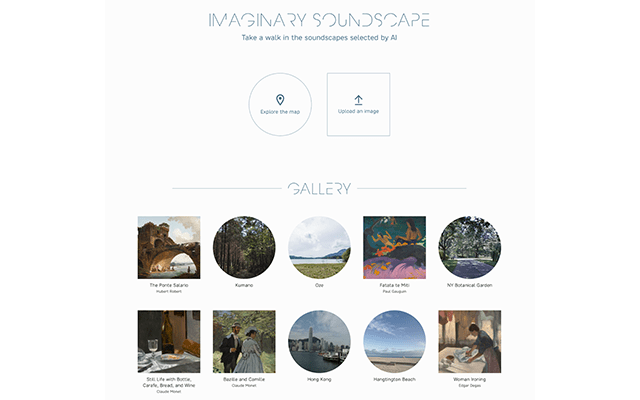

人は一枚の風景写真から、例えば海辺の写真からはさざなみの音を、渋谷のスクランブル交差点の写真からは信号の音など、その場にいたら聞こえるであろう音を想像することがあります。本プロジェクトでは、そのように人が無意識にも想像する行為を、AIを使って外部化したウェブサービスです。ユーザーが選択した画像に基づき、6万個以上のサウンドクリップを含む音声ライブラリーの中からAIが最も合っている音を選び出します。また、Googleストリートビューモードでは、世界中のどこでも好きな場所を歩き回りながら、AIがその場で「想像した」サウンドスケープを体感することができます。本プロジェクトは2017年の開始以来高い注目を集め、これまでに全世界から50万人近くのユーザー様にご利用を頂いています。

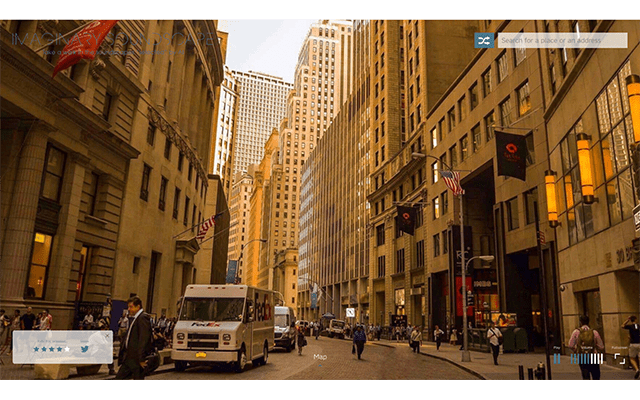

ストリートビューの写真に合った環境音を見つけてくれるGoogleストリートビューモード

ストリートビューの写真に合った環境音を見つけてくれるGoogleストリートビューモード

- 最新版でアップデートされた機能

今回のアップデートにおいては、モデル精度の向上、音声データベースの拡充、UIの向上の3つの変更を加えました。識別モデルをベースにしたモデルから、コントラスティブ学習によるマルチモーダルなモデルに変更しました。また、マッチングの対象となるサウンドデータのライブラリを大幅に拡充しています。これにより今までよりも多様なニュアンスの違いに対してマッチングの感度を高めることができました。

また、初めて利用するユーザー様にも親しみやすいようにインターフェースを向上し、これまでの英語表記に加え、日本語の翻訳も付け加えました。

- 「Img2Sound(イメージtoサウンド)」エンジンのライセンス提供

この度の新バージョンの開発完了により、本技術の完成度が一定水準に達したことを受け、Imaginary Soundscapeのコア技術である「Img2Sound(イメージtoサウンド)」エンジンのライセンス提供を開始しました。

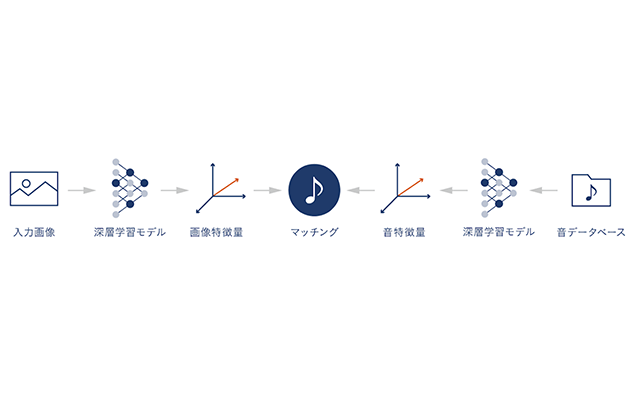

Img2Sound(イメージtoサウンド)エンジンは、深層学習アルゴリズムによって構築された、画像と音声のそれぞれを多次元の抽象的なベクトル表現に置き換えるための事前学習モデルから構成されます。関連性の高い画像と音声がマッチングされるよう、この2つのベクトル空間をコントラスティブ学習(Contrastive Learning)と言われる手法を応用した比較学習を行うことで、異なる2種類のモダリティー(ここでは画像と音)の類似性を定量化することを可能にしています。本技術はテキストと音、ビデオと音、など様々な種類のメディアを関連付ける事ができる応用性の高い技術となっており、これまでにも弊社ではクライアント企業様の製品・サービス・プロジェクトへのマルチモーダルAI技術の導入支援を行ってきました。

・Imaginary Soundscape 技術解説ページ(旧バージョン技術に関してのみ記載、近日アップデート予定):https://qosmo.jp/projects/imaginarysoundscape/

図:Img2Sound(イメージtoサウンド)システム概念図

図:Img2Sound(イメージtoサウンド)システム概念図

- 過去の作品展示・受賞履歴

| 2017年12月 | 深層学習に関する有力な国際会議 NeurIPS: Machine Learning for Creativity and Designに論文が採択 |

| 2018年2月 | Media Ambition Tokyo 2018にて“Imaginary Soundwalk” を出展 ※本ウェブサービスの仕組みを応用したサウンドインスタレーション |

| 2018年10月 | 「Experiments with Google — AI Experiments」に掲載 |

| 2018年12月 | 「Favorite Website Award (FWA) Site of the day」を受賞 |

■株式会社Qosmo(コズモ)

2009年設立。「アートとテクノロジーを通じて人類の創造性を拡張する」をビジョンに掲げる。アーティスト、研究者、プログラマ、デザイナーから構成されるチームが、作品制作を通して創造性のフロンティアを切り開くとともに、アーティスト・企業・個人が使えるAIツールを提供することでより寄多くの人が創造的に働き・学び・暮らせる社会の構築に与することをミッションに活動する。https://qosmo.jp

2009年設立。「アートとテクノロジーを通じて人類の創造性を拡張する」をビジョンに掲げる。アーティスト、研究者、プログラマ、デザイナーから構成されるチームが、作品制作を通して創造性のフロンティアを切り開くとともに、アーティスト・企業・個人が使えるAIツールを提供することでより寄多くの人が創造的に働き・学び・暮らせる社会の構築に与することをミッションに活動する。https://qosmo.jp

あなたの会社のニュースを掲載しませんか?

ニュースへの新規掲載お申込み(無料)